Encuentro #025: Convivir con la IA y estrategias SEO/GEO para B2B de nicho

En este Encuentro, nuestro director analiza cómo, tras el alarmismo inicial, parece que hemos llegado a una etapa de convivencia: los usuarios siguen empleando tanto la IA como Google. Además, en el artículo de esta semana mostramos cómo logramos hacer encontrables a empresas B2B muy especializadas.

El ecosistema de búsqueda en 2026: del monopolio de la IA a la convivencia estratégica

Han pasado solo algo más de tres años, pero ya da la impresión de que la IA siempre estuvo ahí. Sin embargo, no se ha confirmado la presunción inicial de que las plataformas de IA generativa sustituirían por completo a Google, como vaticinaban algunos: Google sigue más vivo que nunca. Lo que sí se confirma es una progresiva fragmentación del hábito de búsqueda: cada usuario elige cómo buscar en función de la complejidad de la tarea, el conocimiento previo sobre lo que busca, el riesgo percibido y la necesidad de validar la respuesta, entre otras variables.

El fin del crecimiento explosivo y el estancamiento de los referidos

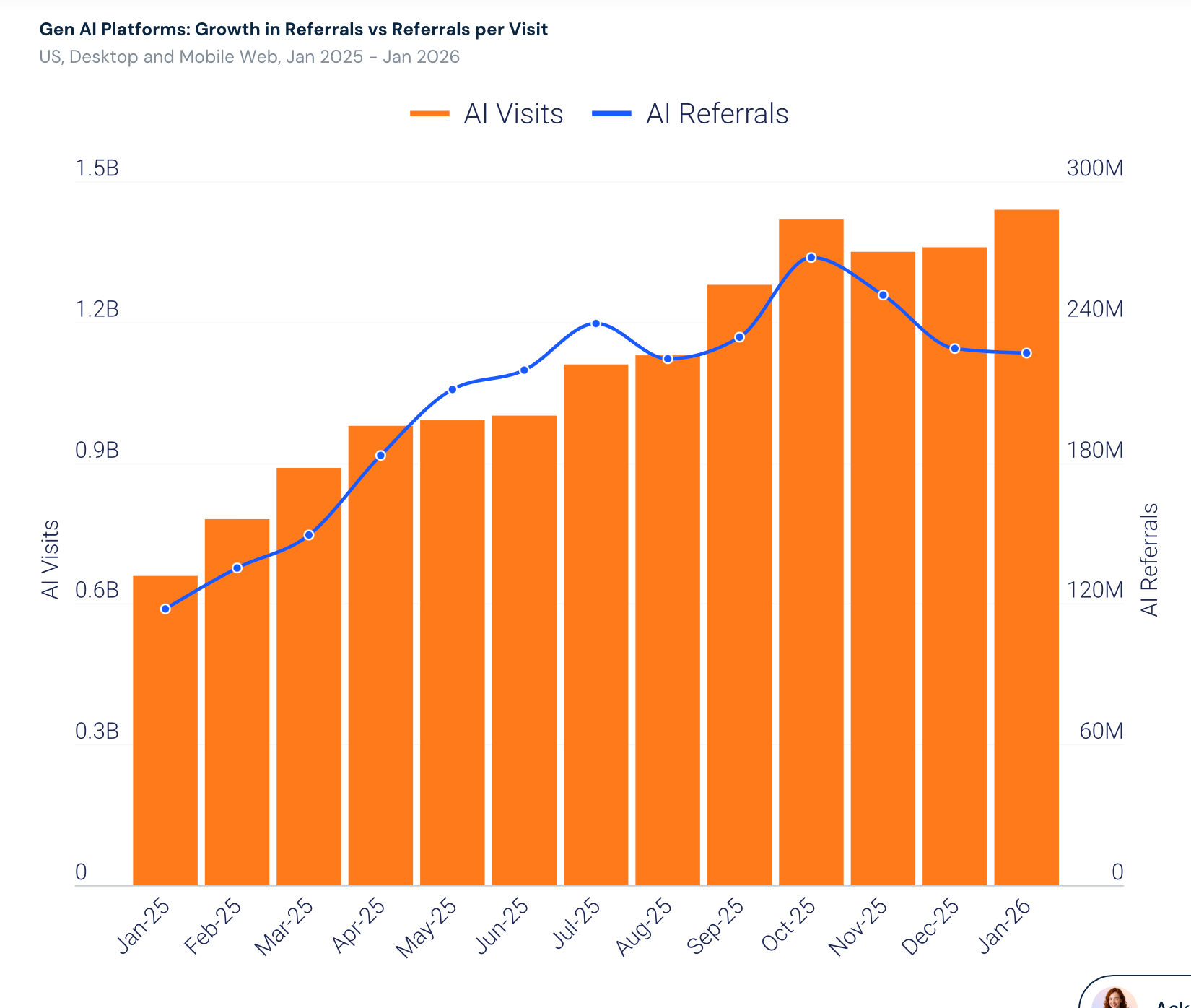

Los datos más recientes del 2026 Generative AI Brand Visibility Report de Similarweb muestran que aunque las visitas a las plataformas de IA crecieron un 28,6% interanual, el tráfico referido por ellas ha comenzado a estancarse e incluso a retroceder.

Específicamente, las plataformas IA refirieron 226,8 millones de visitantes en EE.UU. en enero de 2026 a la muestra de sitios controlados por Similarweb, lo que supone una caída del 15% respecto a los 267,4 millones registrados en octubre de 2025. Este "techo" de tráfico referido sugiere que la IA se está consolidando más como un motor de respuestas directas o zero-click que como un generador de tráfico masivo para las marcas.

La era del monopolio de ChatGPT ha terminado

Otro hallazgo importante del estudio de Similarweb es la progresiva pérdida de hegemonía de ChatGPT. En solo doce meses, su cuota de tráfico dentro del ecosistema de IA cayó del 86,7% al 64,5% en favor de competidores que van acortando distancias:

- Google Gemini: ha pasado de una cuota del 5,7% al 21,5%, alcanzando los 1.100 millones de visitas mensuales.

- Claude (Anthropic): se consolida con 157 millones de visitas mensuales, posicionándose como una alternativa robusta para tareas de síntesis y con un ritmo de crecimiento mucho mayor.

¿Por qué el usuario sigue recurriendo a Google?

A pesar de la comodidad y experiencia de usuario que ofrecen las plataformas IA, la confianza sigue siendo su principal hándicap. Un reciente estudio cualitativo de Nielsen Norman Group explica este fenómeno: los usuarios observados realizaban un constante "ping-pong" entre la IA y el buscador tradicional por los siguientes motivos:

- Validación de datos críticos: los usuarios desconfiaron de la IA para datos exactos como precios o información técnica ("Aquí es donde ChatGPT comienza a perder su encanto", comentaba un participante del estudio tras un error).

- Riesgo y autoridad: ante decisiones importantes, como compras de productos de alto precio o consultas relacionadas con la salud, los usuarios prefirieron ir directamente a fuentes reputadas encontradas a través de Google.

- La barrera de las citas: sigue siendo complicado asociar afirmaciones específicas de los resultados de ChatGPT o Gemini con sus fuentes originales, lo que genera, en opinión de los participantes, una sensación de falta de control sobre la veracidad o exactitud de la información.

El "espejismo" de las visitas

Por último, la disparidad entre "visitar" y "buscar" queda patente en los datos de SparkToro. Los datos de tráfico de ChatGPT, por ejemplo, no nos cuentan la realidad de cuántas de esas visitas utilizaron la plataforma IA realmente para buscar.

Así, mientras que el 97% de quienes entran en Google realizan una búsqueda, solo el 56% de los visitantes de ChatGPT interactúan realmente con prompts. Muchos usuarios acceden simplemente para consumir respuestas compartidas por otros, o para usos distintos de la plataforma, lo que infla las métricas de tráfico pero no refleja un uso activo de búsqueda asimilable al de Google.

¿Qué conclusiones podemos extraer?

Las plataformas IA no han sustituido a Google ni parece que lo harán a medio plazo. Se perfilan como herramientas complementarias en un entorno de búsqueda cada vez más híbrido. Muchos usuarios optan por plataformas IA porque sienten que les ahorra costes de interacción y les ayuda a estructurar ideas vagas o comparar múltiples restricciones.

Sin embargo, Google se mantiene como el validador definitivo. Para las marcas, la estrategia en 2026 no debe ser elegir entre posicionar en Google o aparecer en los resultados generativos, sino entender que el contenido de autoridad sobre su marca en su sitio web o en otros sitios de referencia sigue siendo, de momento, el destino final donde el usuario busca la certeza que la IA aún no le puede dar.

Sección firmada por Fernando Maciá 🖊️

Más allá del volumen de búsqueda: estrategia SEO/GEO en mercados B2B especializados y de nicho

¿Se puede hacer SEO/GEO si tu empresa ofrece un producto o servicio poco conocido? Sí, se puede, pero no con las mismas estrategias que en mercados generalistas. En el artículo de esta semana, Paolo Gorgazzi te cuenta cómo ayudamos en Human Level a empresas B2B muy especializadas a ganar visibilidad, incluso cuando los usuarios todavía no saben cómo referirse a sus productos.

Asegúrate de que tu estrategia de encontrabilidad está a la vanguardia. Contacta con nuestro equipo y logra tus objetivos.

El radar

- Introducing a new spam policy for "back button hijacking": Google ha anunciado una actualización en sus políticas de spam para combatir el "secuestro del botón para volver" (back button hijacking). Esta práctica engañosa ocurre cuando un sitio web interfiere con la navegación, impidiendo que el usuario regrese a la página anterior y redirigiéndolo en su lugar a anuncios o contenido no deseado. A partir de ahora, los sitios que utilicen esta técnica podrán ser sancionados en los resultados de búsqueda para proteger la experiencia del usuario.

- LLM Ranking Factors: What Actually Determines Whether AI Recommends Your Brand: Este artículo de Aiso analiza los factores que determinan cómo los modelos de lenguaje (LLMs) seleccionan y citan marcas. Algunos indicadores clásicos del SEO (volumen de búsqueda de la marca, actualidad, autoridad temática) siguen siendo tan importantes como siempre, pero otros pierden relevancia. Además, debemos prestar atención a nuevos indicadores (claridad de la entidad, capacidad de extracción de datos estructurados, presencia multiplataforma evaluada por rastreadores de IA en lugar de Google) que están emergiendo como factores distintivos de la búsqueda en plataformas IA.

- Don't Measure Once: Measuring Visibility in AI Search (GEO): Philipp Kaufmann, Julius Schulte y Malte Bleekerhan han analizado en este estudio cómo varía la visibilidad en la IA en función de búsquedas repetidas, diferentes indicaciones, sectores y plataformas de búsqueda de IA. El estudio demuestra que a diferencia de los buscadores clásicos, donde los resultados son estables, las respuestas de la IA son probabilísticas y variables. Por ello, medir la visibilidad de una marca ya no depende de una consulta única, sino de mediciones repetidas para entender su presencia como una distribución de resultados en lugar de una posición fija.

- Por qué ChatGPT cita una página en lugar de otra: Estudio de 1,4 millones de prompts: En este exhaustivo estudio, Ahrefs analiza 1,4 millones de prompts de ChatGPT para entender qué determina si una página es citada o no. Los resultados revelan que solo el 50% de las URL recuperadas por ChatGPT son citadas en sus respuestas. El 88% de las citas provienen de resultados de búsqueda, mientras que Reddit representa el 67,8% de las URL no citadas, pese a ser ampliamente consultado por la IA. La conclusión es que para ser citado, tu contenido debe posicionar en la búsqueda, tener un título semánticamente relevante para las subpreguntas de la IA y contar con metadatos optimizados.

- The AI Slop Loop: Lily Ray firma este artículo sobre el fenómeno del AI Slop: contenido de baja calidad generado por IA que contamina los resultados de búsqueda. La facilidad para generar contenido masivo está provocando una inundación de páginas de baja calidad que, aunque pueden conseguir tráfico a corto plazo, erosionan la confianza del usuario y la integridad de las marcas. Los sitios web que se limitan a replicar y reescribir contenido existente con IA acabarán atrapados en una espiral de desvalorización, mientras que la verdadera ventaja competitiva reside en el E-E-A-T (Experiencia, Pericia, Autoridad y Confianza) y en aportar valor genuino que no pueda ser automatizado.